Нейросеть «Яндекса» научилась создавать плавные движения в видео

«Яндекс» представил бета-версию нейросети YandexART (Vi) для созданияпятисекундных видео по текстовым промтам. ИИ-модель обучили воссоздаватьплавные движения объектов в кадре, например бег собаки, падение листа с дереваили взрыв фейерверка, сообщили в пресс-службе компании.

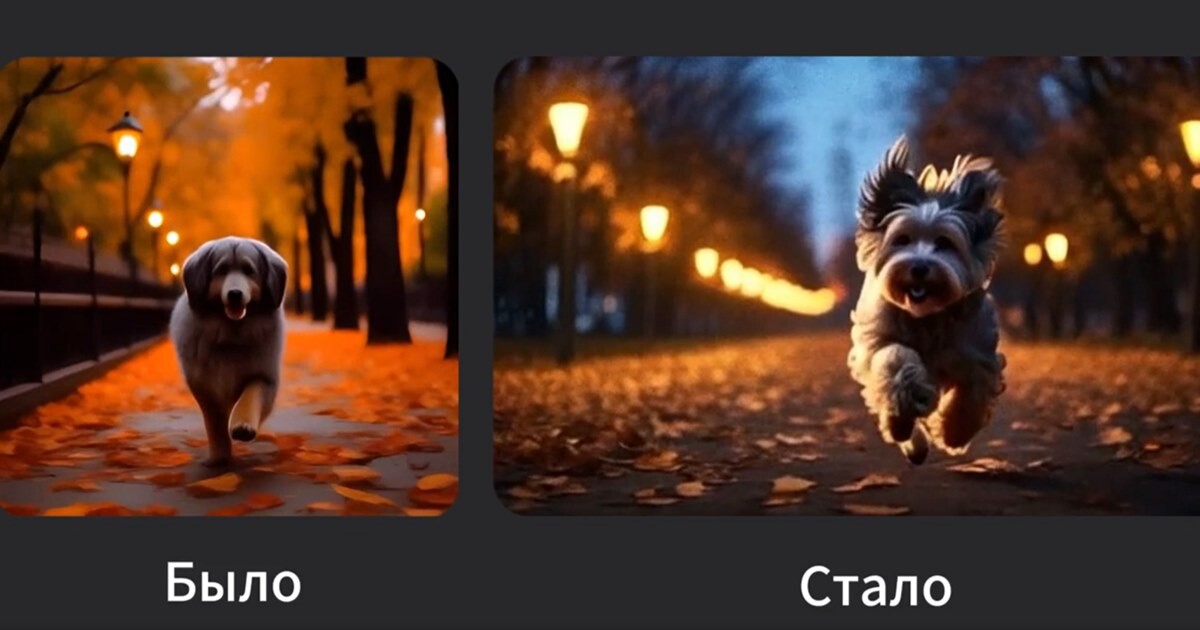

Компания представила предыдущую версию модели для генерации видео потекстовому описанию в августе 2023 г. Прошлое решение позволяло получатьанимации, которые выглядели так, будто двигалась камера, но не объект. Крометого, от кадра к кадру объекты при генерации значительно менялись. YandexART(Vi) научилась воссоздавать реалистичные движения, а также учитывать связьмежду кадрами. Чтобы нейросеть могла справляться с этой задачей, ее обучили нароликах с движущимися объектами, например с едущим автомобилем или крадущимсякотом.

На входе модель получает текстовое описание от пользователя о том, чтодолжно быть в кадре. После чего нейросеть создает картинку, с которой будетначинаться анимация. Затем модель постепенно превращает цифровой шум впоследовательность кадров, опираясь на это изображение и текстовыйзапрос.

В «Яндексе» отметили, что нейросеть могут использовать как обычныепользователи, чтобы создать, например, анимированную заставку на телефон, так иблогеры, мультипликаторы, креаторы и другие специалисты. YandexART (Vi)доступна в приложении «Шедеврум».

Ранее нейросеть YandexGPT от «Яндекса»научилась распознавать и переводить текст с изображений,аудио- и видеофайлов.

Источник: ria novosti